최초의 인공 신경망은 1943년 맥컬러-피츠(McCulloch-Pitts) 모델이며, 연구를 통해 인간의 신경계를 이진 뉴런으로 표현하고자 했다. 이들은 전기 스위치처럼 온, 오프하는 기초 기능의 인공 신경을 그물망 형태로 연결하면 사람의 뇌에서 동작하는 아주 간단한 기능을 흉내 낼 수 있다는 것을 이론적으로 증명하였다. 이들이 정의한 인공 신경망 모델은 이진 뉴런으로 구성되며 생체 뉴런과 같이 시냅스의 흥분과 억제에 따라 신호가 전달되고 특정 임계치를 넘어야 신호가 발화한다.

1. 뉴런은 활성화되거나 혹은 활성화되지 않은 2 가지 상태이다. 즉, 뉴런의 활성화는 all-or-none 프로세스이다.

2. 어떤 뉴런을 흥분되게(excited) 하려면 2개 이상의 고정된 수의 시냅스가 일정한 시간 내에 활성화 되어야 한다.

3. 신경 시스템에서 유일하게 의미 있는 시간지연(delay) 은 시냅스에서의 지연이다.

4. 어떠한 억제적인(inhibitory) 시냅스는 그 시각의 뉴런의 활성화(activation)를 절대적으로 방지한다.

5. 신경망의 구조는 시간에 따라 변하지 않는다.

출처: http://www.aistudy.co.kr/neural/McCulloch_Pitts.htm

McCulloch-Pitts Model

초기의 신경 시스템 모델 중에서 아마도 가장 잘 알려진 것은 1943년 Warren McCulloch 과 Walter Pitts 에 의해 제안된 모델일 것이다. 그들은 인간의 두뇌를 논리적 서술을 구현하는 이진 원소들의 결합

www.aistudy.co.kr

1950년 영국 수학자 앨런 튜링은 ‘계산 기계와 지능(Computing Machinery and Intelligence)’이라는 논문에서 기계가 생각할 수 있는지 테스트하는 방법(튜링 테스트), 지능적 기계의 개발 가능성, 학습하는 기계 등에 대해 기술하였다. 일반적으로 이를 인공지능 연구의 시작으로 본다.

맥컬러-피츠(McCulloch-Pitts)의 모델은 학습 과정이 없기 때문에 문제에 따라 매번 신경망의 구성을 바꿔야 했다. 이러한 문제점을 해결하기 위해 1956년 프랭크 로젠블랫(Frank Rosenblatt)은 인공 신경망이 스스로 학습하는 모델인 퍼셉트론(perceptron)을 개발했다. 퍼셉트론은 두 종류의 클래스를 직선으로 구분하는 선형 분류기이다.

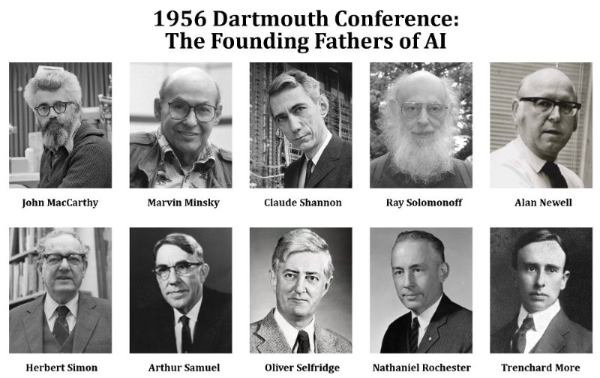

1956년 당시 다트머스 대학에 있던 존 매카시가 인공지능에 관한 연구프로젝트로 약 8주간 학술회의를 개최하였는데 이때 록펠러 재단에 제출한 연구 제안서에 인공지능(Artifitial Intelligence)이라는 용어를 처음 사용하였다.

기호주의 학파의 수장이었던 마빈 민스키는 1969년 그의 저서 「퍼셉트론」에서 로젠블랫의 퍼셉트론은 비선형 문제를 풀 수 없다는 한계를 지적하고 이를 입증했다. 이것이 XOR 문제이다.

퍼셉트론으로 비선형 문제를 풀려면 퍼셉트론을 여러 계층으로 표현하는 다층 퍼셉트론이 필요하다.(Multi Layered Perceptron) 다층 퍼셉트론의 은닉층에서 좌표 평면이 왜곡되고 두 영역을 가르는 직선이 만들어진다. 로젠블랫은 다층 퍼셉트론을 설계했지만 학습 규칙을 만드는 데 실패했다.

출처: https://colah.github.io/posts/2015-09-NN-Types-FP/

Neural Networks, Types, and Functional Programming -- colah's blog

Neural Networks, Types, and Functional Programming Posted on September 3, 2015 <!-- by colah --> Deep Learning Thirty Years in the Future --> An Ad-Hoc Field Deep learning, despite its remarkable successes, is a young field. While models called artificial

colah.github.io

1980년대 후반 인공 신경망을 연구하던 과학자들에 의해 다층 퍼셉트론을 학습시킬 수 있는 역전파 알고리즘이 주목을 받기 시작했다. 역전파 알고리즘은 1974년 하버드 대학의 폴 워보스가 최초로 제안했다.

인공 신경망은 학습 과정에서 출력과 정답의 오차를 최소화하도록 최적화(optimization)를 수행한다. 이때 각 파라미터의 오차에 대한 기여도를 미분으로 계산해서 오차를 최소화하는 방향으로 파라미터를 조정한다. 역전파 알고리즘은 신경망의 뉴런에 분산된 파라미터의 미분을 효율적으로 계산하기 위한 알고리즘이다. 출력 계층에서 입력 계층 방향으로 한 계층씩 이동하면서 미분을 계산하고 다음 계층에 전파하는 과정을 통해 계산의 중복 없이 모든 파라미터의 미분을 한 번의 패스에 계산한다. 역전파 알고리즘을 통해 다층 퍼셉트론을 학습시킬 수 있게 되면서 그동안 퍼셉트으로는 풀 수 없었던 비선형 문제를 풀 수 있게 되었다.